7.30-8.1 全数会2025(第六届)机器人及智能工厂展

火热报名中>>

三星正在研发6亿像素的摄像头模组,如此高的像素真的好吗?

这也就引出了第二个概念:分辨率。

其实,在不同情况下我们所说的分辨率也是不同的概念,例如在提到数码图像时所说的分辨率在英语中是Resolution,在提到数码打印或显示器时所说的分辨率其实是ppi(pixels per inch,每英寸像素数)等,小黑在这里主要说明的,还是我们在拍摄照片、视频时会遇到的分辨率,即Resolution。

其实,数码像素与数码图像分辨率的换算其实很简单,将数码图像分辨率简单相乘,就可以得到一张图片的数码像素数了。

以小米10为例,在进入一亿像素拍照模式之后所拍摄的照片,分辨率会达到9024×12032px,像素数大约是1亿零857万个,因此我们可以在小米10的摄像头上看到108MP的字样。

至于小米10的一亿像素究竟有没有用,在开头提到的那篇文章中也有实际样张对比,下面的对比图片也可以看出它们的区别。

在上面的图片中,左边是主摄像头为5000万像素的某型号手机所拍的照片,右边是小米手机108M模式所拍摄的照片,差别还是很明显的。

所以,像素数量的高低,确实是影响图片质量的重要因素之一。

像素越高,拍摄的照片真的更好吗?

既然像素的高低能够影响图片质量,那么为何高端专业相机现在大多也只有4000万~6000万像素呢(以索尼α7R3和α7R4为例)?

关于这一点,小黑也曾在《一亿像素和大底大像素传感器,手机拍照到底挑哪个?》一文中做过简单的说明。在那篇文章中,小黑给出的一个重要原因就是传说中的“底大一级压死人”。

上图中列出了一部分常见图像传感器的尺寸,其中放在最上面的,就是常见高端相机中使用的全画幅传感器,最下面的,则是目前手机中经常使用的传感器。可以看出,相机传感器与手机传感器在尺寸上有天壤之别。

我们都知道,人眼能够看到物体,是因为物体反射了光线映入人眼的结果,而图像传感器的成像也运用了这一原理。

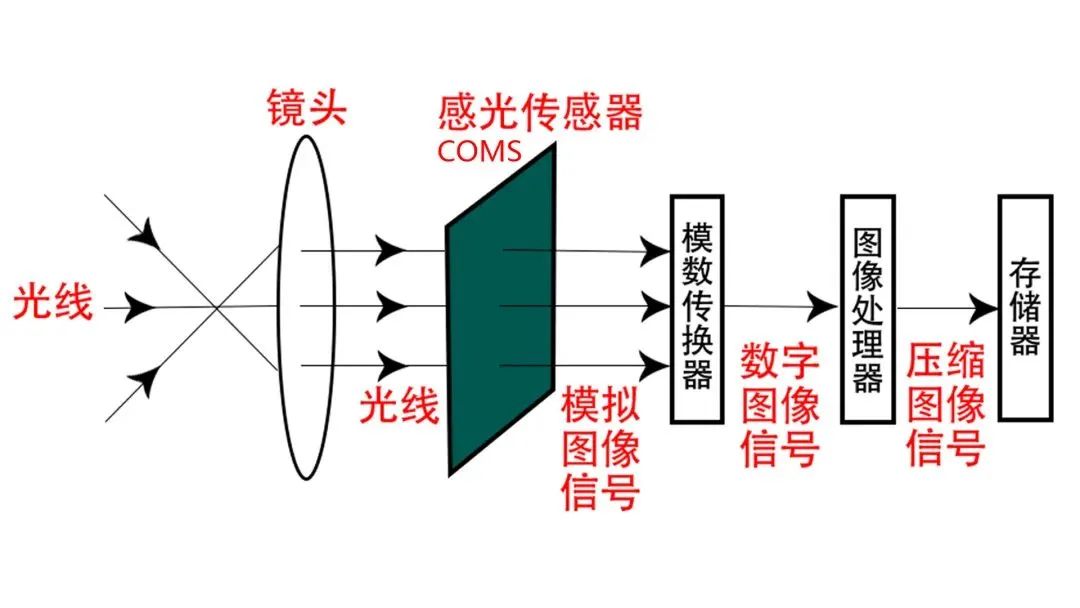

当我们使用相机拍摄物体时,物体反射的光线会通过镜头透射到图像传感器上,图像传感器再将其收集,并通过一系列复杂的步骤将这些光线转换成数字信号,最后经过色彩校正等调整,再存储为图像的。

因此,传感器的尺寸,才是影响照片质量的重中之重。原因很简单,图像传感器的尺寸越大,单个像素能够感应光线的面积也就越大,也就可以记录下更多的信息,不论是成像质量还是宽容度、暗光表现也会更好。

这也是苹果为什么至今还在用“老掉牙”的1200万像素摄像头系统的原因之一。

除了图像传感器的尺寸之外,决定成片质量的另一个重点,就是镜头。

图片新闻

技术文库

最新活动更多

-

3月27日立即报名>> 【工程师系列】汽车电子技术在线大会

-

4月1日立即下载>> 【村田汽车】汽车E/E架构革新中,新智能座舱挑战的解决方案

-

即日-4.22立即报名>> 【在线会议】汽车腐蚀及防护的多物理场仿真

-

4月23日立即报名>> 【在线会议】研华嵌入式核心优势,以Edge AI驱动机器视觉升级

-

4月25日立即报名>> 【线下论坛】新唐科技2025新品发布会

-

4月30日立即参与 >> 【白皮书】研华机器视觉项目召集令

推荐专题

分享

分享

发表评论

请输入评论内容...

请输入评论/评论长度6~500个字

暂无评论

暂无评论